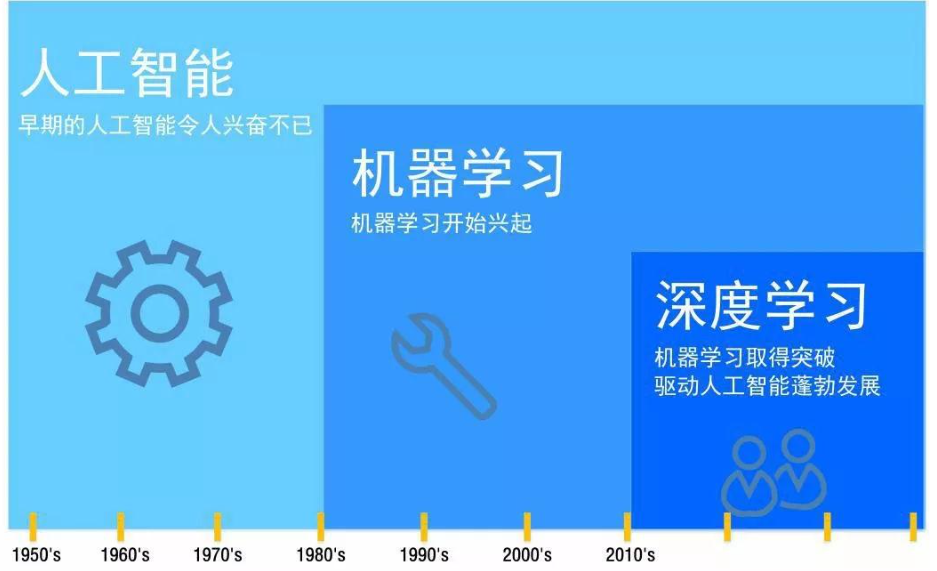

- 机器学习

- 机器学习相关知识

目录

- # 1. 传统机器学习

- 1-1. 机器学习前言 1-2. 数据预处理 1-3. 简单线性回归 1-4. 多元线性回归 1-5. 逻辑回归(一) 1-6. 逻辑回归(二) 1-7. K近邻法(k-NN) 1-8. k最近邻分类任务代码演示 1-9. 支持向量机(SVM) 1-10. 使用SVM进行二分类 1-11. 决策树 1-12. 随机森林 1-13. 什么是K-means聚类算法 1-14. 使用K-Means算法进行数据聚类:以鸢尾花数据集为例

- # 2. 联邦学习

- 2-1. 联邦学习中的基础算法介绍 2-2. Advances and Open Problems in Federated Learning 2-3. Vertical Federated Learning Concepts,Advances, and Challenges 2-4. 机器学习中的并行计算 2-5. Boosted Trees 简介 2-6. SecureBoost:一种无损的联邦学习框架 2-7. FedGen & Data-Free Knowledge Distillation for Heterogeneous Federated Learning 2-8. Towards Personalized Federated Learning 2-9. Distilling the Knowledge in a Neural Network 2-10. FedMD & Heterogenous Federated Learning via Model Distillation 2-11. FedFTG & Fine-tuning Global Model via Data-Free Knowledge Distillation for Non-IID Federated Learning 2-12. MOON & Model-Contrastive Federated Learning 2-13. Knowledge Distillation in Federated Learning:A Practical Guide 2-14. DKD-pFed & A novel framework for personalized federated learning via decoupling knowledge distillation and feature decorrelation 2-15. pFedSD & Personalized Edge Intelligence via Federated Self-Knowledge Distillation 2-16. FedFD&FAug:Communication-Efficient On-Device Machine Learning:Federated Distillation and Augmentation under Non-IID Private Data

上次更新: 2025/10/30, 11:12:14